Урок 8

§7. Основополагающие принципы устройства ЭВМ

Содержание урока:

7.1. Принципы Неймана-Лебедева

7.1. Принципы Неймана-Лебедева (продолжение)

7.2. Архитектура персонального компьютера

7.3. Перспективные направления развития компьютеров

7.1. Принципы Неймана-Лебедева

В каждой области науки и техники существуют фундаментальные идеи или принципы, определяющие на многие годы вперёд её содержание и направление развития. В компьютерных науках роль таких фундаментальных идей сыграли принципы, сформулированные независимо друг от друга двумя крупнейшими учёными XX века — Джоном фон Нейманом и Сергеем Алексеевичем Лебедевым.

Принцип — основное, исходное положение какой-нибудь теории, учения, науки и пр.

Принцип — основное, исходное положение какой-нибудь теории, учения, науки и пр.

Принципы Неймана-Лебедева — базовые принципы построения ЭВМ, сформулированные в середине прошлого века, не утратили свою актуальность и в наши дни.

Принципы Неймана-Лебедева — базовые принципы построения ЭВМ, сформулированные в середине прошлого века, не утратили свою актуальность и в наши дни.

|

Джон фон Нейман (1903-1957) — американский учёный, сделавший важный вклад в развитие целого ряда областей математики и физики. В 1946 г., анализируя сильные и слабые стороны ЭНИАКа, совместно с коллегами пришёл к идее нового типа организации ЭВМ. |

| Сергей Алексеевич Лебедев (1902-1974) — академик, основоположник вычислительной техники в СССР, главный конструктор первой отечественной электронной вычислительной машины МЭСМ, автор проектов компьютеров серии БЭСМ (Большая Электронная Счётная Машина), разработчик принципиальных положений суперкомпьютера «Эльбрус». В 1996 году посмертно награждён медалью «Пионер компьютерной техники» — самой престижной наградой международного компьютерного сообщества. |  |

Рассмотрим сущность основных принципов Неймана-Лебедева:

1) состав основных компонентов вычислительной машины;

2) принцип двоичного кодирования;

3) принцип однородности памяти;

4) принцип адресности памяти;

5) принцип иерархической организации памяти;

6) принцип программного управления.

Первый принцип определяет состав основных компонентов вычислительной машины.

Первый принцип определяет состав основных компонентов вычислительной машины.

Любое устройство, способное производить автоматические вычисления, должно иметь определённый набор компонентов: блок обработки данных, блок управления, блок памяти и блоки ввода/вывода информации.

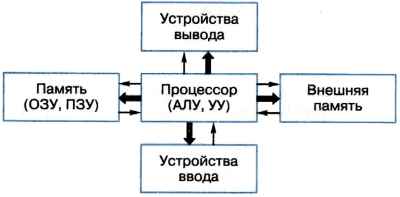

Функциональная схема такого компьютера, отражающая программное управление работой и взаимодействием его основных узлов, представлена на рисунке 2.5.

Рис. 2.5. Функциональная схема компьютеров первых поколений

Его информационным центром является процессор:

• все информационные потоки (тонкие стрелки на рисунке) проходят через процессор;

• управление всеми процессами (толстые стрелки на рисунке) также осуществляется процессором.

Такие блоки есть и у современных компьютеров. Это:

• процессор, состоящий из арифметико-логического устройства (АЛУ), выполняющего обработку данных, и устройства управления (УУ), обеспечивающего выполнение программы и организующего согласованное взаимодействие всех узлов компьютера;

• память, предназначенная для хранения исходных данных, промежуточных величин и результатов обработки информации, а также самой программы обработки информации. Различают память внутреннюю и внешнюю. Основная часть внутренней памяти используется для временного хранения программ и данных в процессе обработки. Такой вид памяти принято называть оперативным запоминающим устройством (ОЗУ). Ещё одним видом внутренней памяти является постоянное запоминающее устройство (ПЗУ), содержащее программу начальной загрузки компьютера. Внешняя или долговременная память предназначена для длительного хранения программ и данных в периоды между сеансами обработки;

• устройства ввода, преобразующие входную информацию в форму, доступную компьютеру;

• устройства вывода, преобразующие результаты работы компьютера в форму, доступную для восприятия человеком.

Вместе с тем в архитектуре современных компьютеров и компьютеров первых поколений есть существенные отличия. О них будет сказано чуть ниже.

Рассмотрим суть принципа двоичного кодирования информации.

Рассмотрим суть принципа двоичного кодирования информации.

Вся информация, предназначенная для обработки на компьютере (числа, тексты, звуки, графика, видео), а также программы её обработки представляются в виде двоичного кода — последовательностей 0 и 1.

Все современные компьютеры хранят и обрабатывают информацию в двоичном коде. Выбор двоичной системы счисления обусловлен рядом важных обстоятельств: простотой выполнения арифметических операций в двоичной системе счисления, её «согласованностью» с булевой логикой, простотой технической реализации двоичного элемента памяти (триггера).

Несмотря на всеобщее признание, использование в компьютерной технике классической двоичной системы счисления не лишено недостатков. В первую очередь это проблема представления отрицательных чисел, а также нулевая избыточность (т. е. отсутствие избыточности) двоичного представления. Пути преодоления указанных проблем были найдены уже на этапе зарождения компьютерной техники.

В 1958 г. в Московском государственном университете им. М. В. Ломоносова под руководством И. П. Брусенцова был создан троичный компьютер «Сетунь» (рис. 2.6). В нём применялась уравновешенная троичная система счисления, использование которой впервые в истории позволило представлять одинаково просто как положительные, так и отрицательные числа.

Итак, благодаря двоичному кодированию, данные и программы по форме представления становятся одинаковыми, а следовательно, их можно хранить в единой памяти.

Рис. 2.6. ЭВМ «Сетунь»